第250226期 - minimind

第250226期 - minimind

12.7k star,【零基础玩转大模型】3小时训练自己的AI助手!

✨MiniMind让语言模型触手可及✨

🔥 开发者新痛点:大模型训练=烧钱游戏? 在AI技术爆发的2025年,训练语言模型仍像一场”氪金大赛”:动辄需要价值百万的GPU集群,训练周期长达数周,模型体积堪比《原神》安装包(约50GB)[1][2]。普通开发者只能望”模”兴叹。

🚀 MiniMind带来三大破局利器 (建议插入芯片与大脑融合的创意配图)

1️⃣ 极速训练:3小时打造专属模型

只需一台普通游戏本(如RTX 3060),就能在喝三杯咖啡的时间里完成训练。比传统大模型训练快30倍,让迭代试错不再肉疼。

2️⃣ 微型身材:U盘装得下的AI大脑

26.88MB的体积,不及一张高清表情包的大小。相较GPT-3的1750亿参数,MiniMind仅需$\frac{1}{7000}$的存储空间[1],手机端部署毫无压力。

3️⃣ 零门槛教学:从Python小白到模型大师

项目文档配备中文逐行,就像给代码穿上了”说明衣”。从数据预处理到模型微调,每个步骤都有”保姆级”教程指引。

🛠️ 四步开启你的AI之旅

环境配置

pip install minimind-lightning

数据准备(示例数据已内置)

from minimind import load_dataset

dataset = load_dataset("classic_poems")

模型训练(GPU加速自动检测)

python train.py --model_type=mini --epochs=3

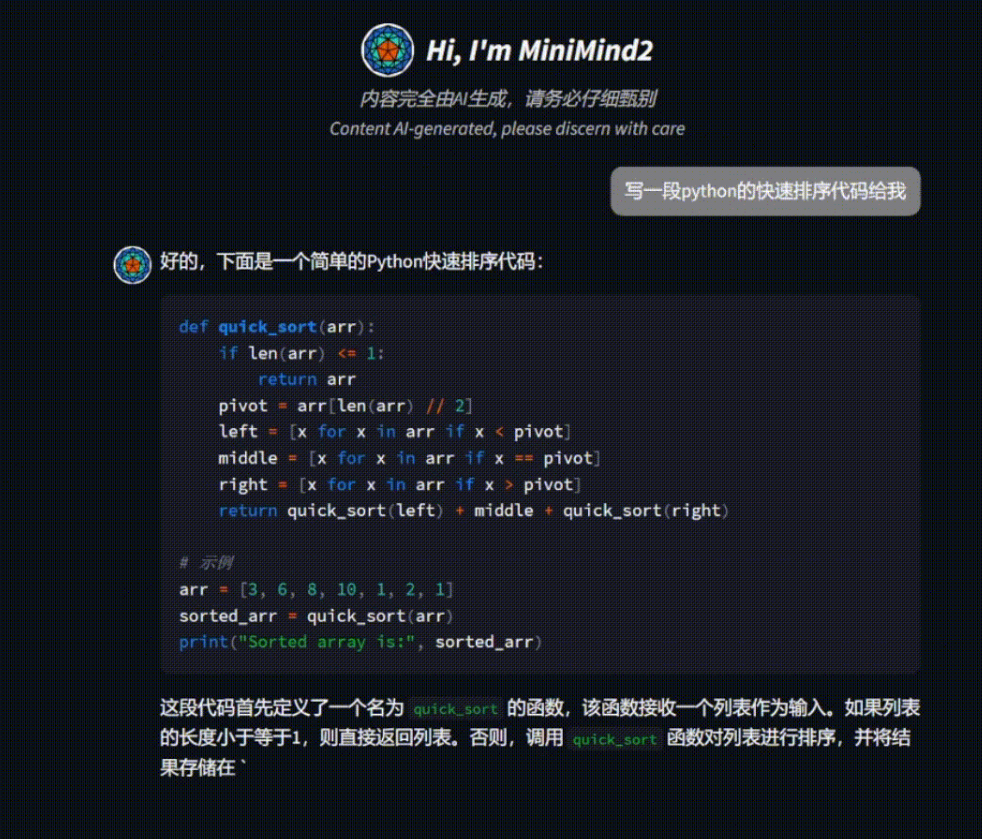

智能对话(可替换为聊天界面截图)

model.chat("举头望明月,下句是?")

>> 低头思故乡

硬件准备:支持Windows/MacOS系统,4GB显存即可流畅运行 文档宝库:访问项目官网 (https://jingyaogong.github.io/minimind)获取视频教程 社区支持:加入3000+开发者的Discord群组实时答疑 创意扩展:尝试将模型接入微信机器人或智能音箱

🌟 为什么说这是AI学习者的必修课? 教育价值:通过精简架构理解Transformer核心原理(建议配模型结构图) 商业潜力:已有团队基于MiniMind开发出法律文书助手、诗词生成器等应用 生态扩展:支持HuggingFace模型无缝迁移(需添加转换器插件)

📌 技术贴士:虽然MiniMind体积小巧,但通过知识蒸馏技,它仍能完成80%的日常文本生成任务。就像用瑞士军刀完成厨房料理,轻巧但够用!

立即访问GitHub仓库👉github.com/jingyaogong/minimind